만약 새가 날아가면서 센서에 똥을 싸기라도 하면 자율 주행이 위험해지는 건 아니냐고요? 갑자기 뭔가 튀어나왔는데 센서가 늦게 파악할 위험은 없냐고요? 걱정 마세요. 다 방법이 있습니다. 무슨 방법이냐고요?

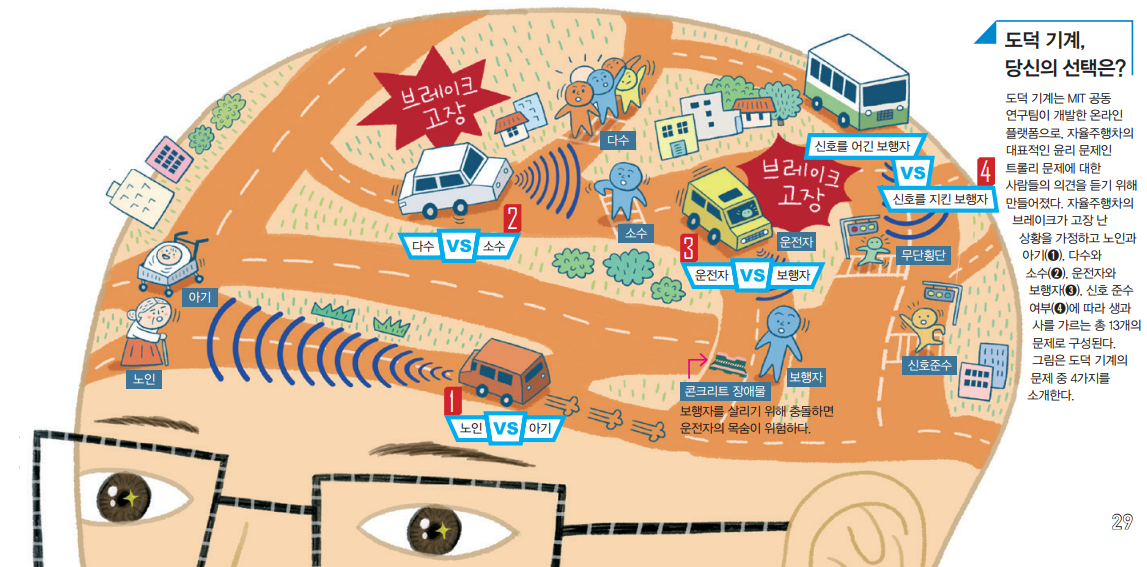

자율주행차의 고민, 트롤리 문제

여러분은 다음 상황에서 어떤 선택을 할 건가요? 브레이크가 고장 난 기차가 시속 100km로 달리고 있어요. 달리던 방향에는 5명이 일하고 있고, 옆 선로에는 1명이 일하고 있지요. 선로를 바꿀 건가요? 대답하기 참 곤란하지요?

이 질문은 1967년 영국의 철학자 필리파 루스 풋 박사가 고안한 사고 실험이에요. ‘트롤리 문제*’로 잘 알려졌죠. 이 문제는 자율주행차를 처음 개발하면서부터 논의되고 있는 대표적인 윤리 문제예요. 인간도 결정을 내리기 쉽지 않은 상황에서 자율주행차는 어떻게 판단해야 할까요?

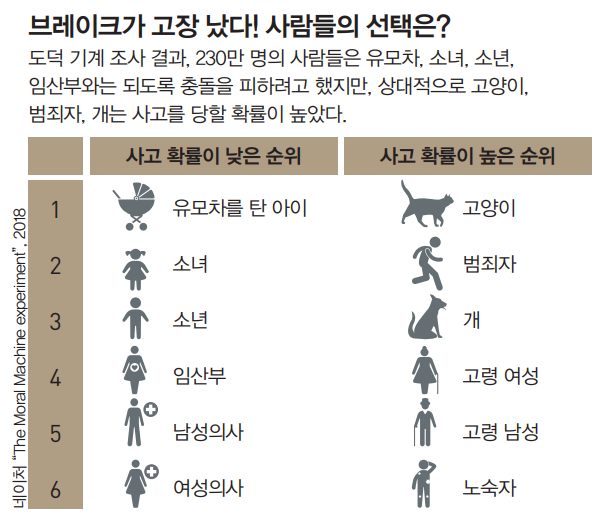

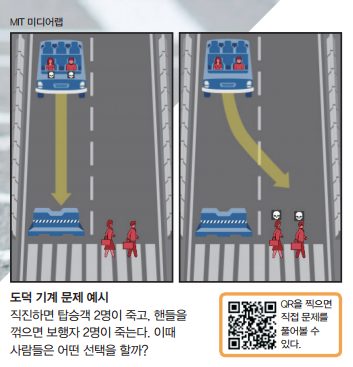

이에 미국 매사추세츠공과대학교(MIT), 하버드대학교, 캐나다 브리티시컬럼비아대학교, 프랑스 툴루즈1대학교 공동연구팀은 2016년 인터넷 플랫폼 ‘도덕 기계(Moral machine)’를 만들었어요. 자율주행차와 같은 인공지능이 수행해야 할 도덕적 결정에 대해 인간의 인식 정보를 모으기 위해서였죠. 도덕 기계는 위와 같은 상황일 때 어떤 선택을 내릴지 질문해요. 자율주행차의 브레이크는 고장 난 상태로 직진과 방향만 바꿀 수 있다고 가정하고, 아래 그림 속 문제들처럼 쉽게 답하기 어려운 문제의 답을 선택해야 해요.

연구팀은 약 2년간 233개 국가 및 도시에 사는 230만 명을 대상으로 얻은 답변을 분석했어요.

그 결과 전 세계적으로 동물보다는 인간을, 노인보다는 아이를, 소수보다는 다수의 사람을 구한다는 답변이 많았어요. 하지만 문화에 따라 차이도 있었어요. 프랑스, 그리스, 캐나다, 영국 등 서양 문화권에서는 아이를 구한다는 답이 높았지만, 반대로 한국, 중국, 싱가포르 등 아시아 국가에서는 노인을 살린다는 답변이 더 많았지요. 이 결과를 토대로 연구팀은 윤리적 결정을 내리는 자율주행차를 허용하기 전에는 지역과 문화를 고려해야 한다고 밝혔어요. 성균관대학교 AI.로봇학과 이지형 교수 역시 “트롤리 문제는 자율주행차를 만드는 사람이 결정할 문제가 아니라, 사회가 결정해줘야 하는 일”이라고 말했답니다.

▲ PDF에서 고화질로 확인할 수 있습니다.

▲ PDF에서 고화질로 확인할 수 있습니다.

_INTERVIEW

황성호(성균관대학교 기계공학과 교수)

인공지능은 어떻게 판단을 내리도록 설정해야 할까요?

자율주행차가 스스로 운전하려면 예기치 못한 상황에서도 사람처럼 적절히 판단할 수 있는 인공지능이 필수적으로 적용돼야 할 거예요. 하지만 트롤리 문제는 사람이 결정을 내리기도 어려운 것들이에요. 사람도 명확히 판단하지 못한 윤리 문제이기 때문에 인공지능이 답을 내리기란 어렵지요. 만약 이런 일이 실제로 발생한다면 자율주행차가 적절히 대응했는지 분석하며 사회적으로 합의해 가야 해요.

용어정리

*트롤리 문제 : 사람들에게 브레이크가 고장 난 기차 상황을 제시하고 다수를 구하기 위해 소수를 희생할 수 있는지를 판단하게 하는 문제 상황.