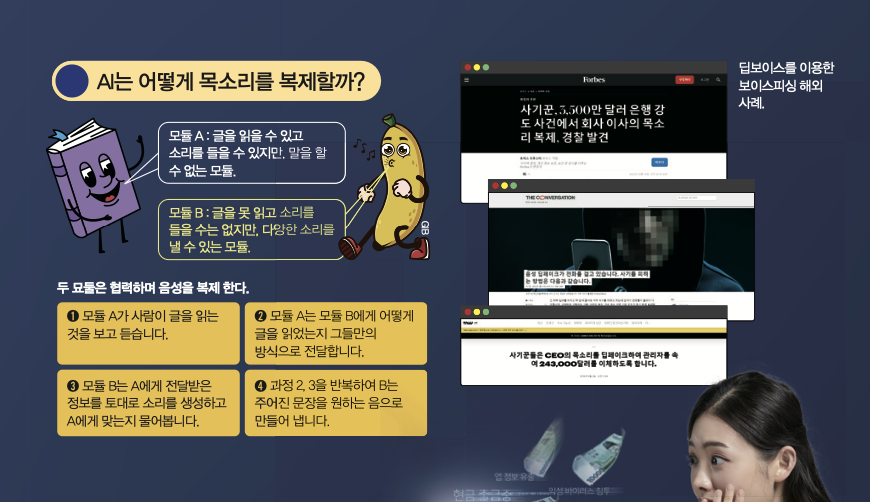

잠깐, 여기서 끝이 아니라고해외에선 음성복제기술을 악용해 가족, 지인의 목소리까지 따라하는 맞춤형 피싱으로 수억 원을 빼앗아 간 사건까지 있었어. 음성 딥페이크가 보이스피싱에 사용된다면 지금보다 더 많은 피해자가 발생할 수도 있다는데!

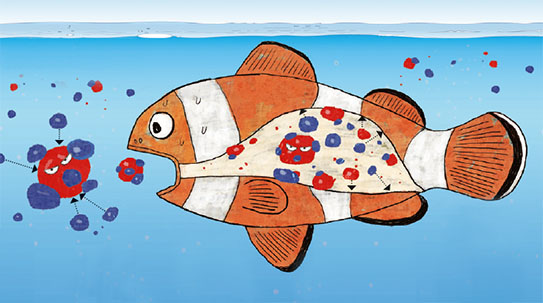

신종범죄 딥보이스 AI 등장

지난 3월 5일, 미국 워싱턴포스트지는 캐나다에 사는 한 할머니가 인공지능(AI)으로 목소리를 만드는 기술인 딥보이스 보이스피싱에 피해를 볼 뻔했다고 보도했어요. 보이스피싱 범죄자들은 손자의 목소리를 복제한 뒤, 할머니에게 전화를 걸어 손자의 목소리로 자동차 추돌사고가 났다며 사고보험금 약 300만 원을 송금해달라고 말했어요. 2021년 아랍에미리트(UAE)의 한 은행은 대기업 임원의 목소리로 420억 원을 보내라는 전화를 받아 피해를 본 사건도 있었어요. 당시 의심 없이 거액을 송금했던 건 익숙한 목소리로 복제한 가짜 음성 때문이었죠. 경찰대학 서준배 교수는 “다행히 아직까지 우리나라엔 이 같은 피해 사례는 없다”고 했습니다.

음성복제기술은 보이스피싱을 위해 만들어진 기술은 아니에요. 디지털 휴먼을 만드는 AI 테크 기업 클레온 진승혁 대표는 “요즘 유행하는 챗GPT처럼 음성복제기술은 생성형 AI모델을 이용해 만든다”며 “목소리 데이터를 기계가 이해할 수 있는 언어로 바꾸고 수치화하면 AI가 특징적인 값을 뽑아내 원하는 목소리로 만들어 낸다”고 했어요. 이어 “원래는 돌아가신 할머니나 좋아하는 연예인이 책을 읽어주거나, 다국어로 소통하는 등 오락과 편리함을 위해 만든 기술”이라면서 “기술이 악용되지 않고 올바르게 사용되려면 결국 제도를 정비하기 위해 사회적으로 논의가 필요하다”고 말했지요.

한국지능정보사회진흥원 채은선 수석연구원은 “현재 우리나라는 AI 기술로 이미지나 음성, 영상 등을 가짜로 만들어내는 딥페이크로 인해 피해를 입은 사람을 보호할 수 있는 법이 국회에 머물러 있다”며 “애초에 AI로 음성이나 영상을 만들 때 출처를 알 수 있도록 워터마크 삽입을 의무화하고, 악용할 경우 처벌할 수 있는 방안 등을 논의해야 한다”고 했어요. 정보보안 전문기업 마크애니 이태윤 연구원은 “오디오 파일에 디지털 신호를 추가하면 사람의 귀에는 들리지 않지만, 컴퓨터로는 식별할 수 있는 오디오워터마크를 만들 수 있다”며, “워터마크 기술이 지금은 콘텐츠 무단 사용이나 배포 등을 막는 데 주로 쓰이고 있는데, 향후 딥보이스 보이스피싱 예방에도 사용될 수 있다”고 말했답니다.