생성 인공지능(AI)이 인간 대신 보고서를 작성하는 세상이 도래했다. 심지어 인간보다 더 잘해내기까지 한다. 인간보다 똑똑한 AI 탄생의 주역은 ‘대규모 언어모델(LLM)’이다. 대규모 언어모델은 로봇공학 분야에도 변곡점이 될 수 있을까. 똑똑한 뇌에 걸맞는 기계 몸이 탄생할지 알아보자.

‘AI 로봇’의 개념은 사실 모호하다. 로봇 연구자들은 인공지능(AI)이 처음 나온 1950년대부터 이미 AI 기술을 로봇에 적용해 왔기 때문이다. 로봇이 ‘인간을 흉내 낸 기계’이므로, 로봇을 움직이는 지능은 모두 인간을 흉내 낸 지능, 즉 인공지능이다. AI가 강조된 로봇들을 과거엔 ‘지능형 로봇’이라고 불렀다.

“최근엔 AI 기술이 추론과 판단에 집중되다 보니, 스스로 판단하고 움직이는 로봇을 AI 로봇이라고 부르는 것 같아요. 하지만 원래 로봇 공학에서는 화면을 인식하는 AI 기능만 탑재돼 있어도 AI 로봇으로 분류되죠.” 김창현 한국기계연구원 인공지능기계연구실 책임연구원은 AI 로봇에 대한 정의는 다양하다고 설명했다. 2024 로봇 트렌드의 중심에 있는 것은 좁은 의미의 AI 로봇, 그러니까 AI를 활용해 스스로 추론하고 움직이는 로봇이다.

스스로 움직이고 자율적인 훈련까지 가능

AI 로봇에서도 가장 핫한 주제는 대규모 언어모델을 활용하는 로봇이다. 자연어를 이해하고 새로운 언어를 만드는 데 탁월한 능력을 지닌 대규모 언어모델은 로봇을 움직이는 데 필요한 코드 작성에도 두각을 나타내기 때문이다.

대표적인 예로 일본 도쿄대 연구팀은 2023년 12월 11일 GPT-4를 탑재한 로봇 ‘Alter(알터)3’에 관한 논문을 공개했다. doi: 10.48550/arXiv.2312.06571 연구팀이 논문과 함께 공개한 영상을 보면, 알터3은 ‘귀신 흉내를 내줘’라는 말을 들으면 두 손을 앞으로 내밀며 입을 벌려 귀신 흉내를 내고, ‘메탈을 연주해 줘’라는 요청엔 기타를 치는 흉내를 낸다. 이때 중요한 건 사람이 로봇에게 구체적으로 어떻게 움직이라고 말할 필요도, 코딩할 필요도 없다는 것이다.

알터3는 크게 두 단계로 작동한다. 인간의 언어를 이해해 명령 수행 과정에 대한 설명을 만드는 단계와, 그 설명을 바탕으로 수행 코드를 작성하는 단계. 두 과정 속 핵심 기술은 GPT-4, 대규모 언어모델이다. 예를 들어 ‘아이폰으로 셀카를 찍어줘’라는 명령에 AI는 1단계, ‘얼굴은 웃고, 팔은 오른쪽으로 올리고, 고개를 오른쪽으로 돌린다’와 같은 구체적인 설명을 생성한다. 그리고 2단계, 설명을 구동할 각각의 코드를 생성하고 코드에 따라 움직인다.

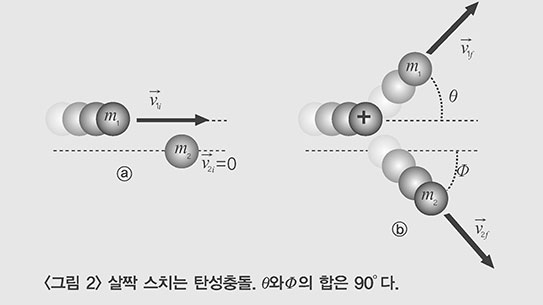

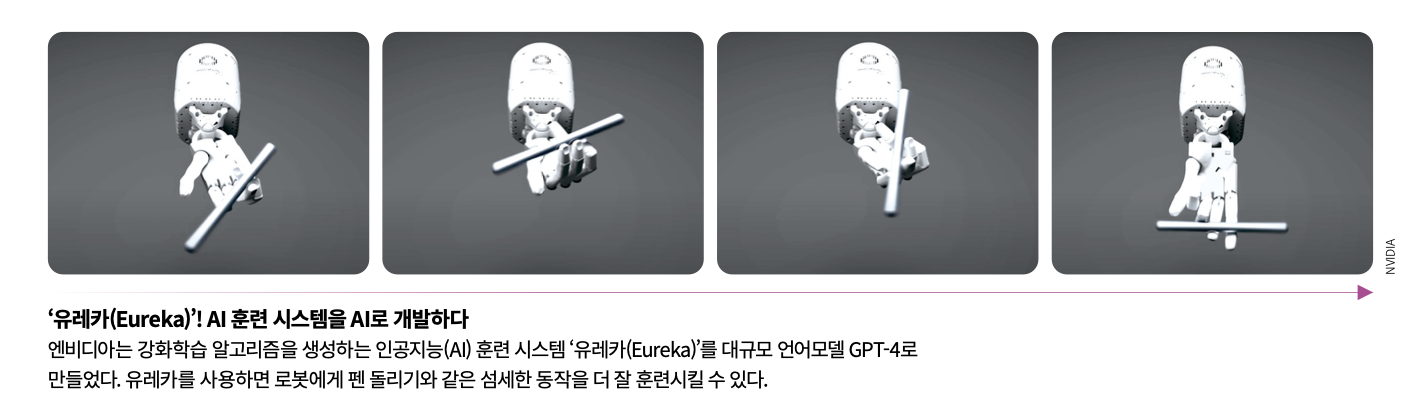

대규모 언어모델로 로봇을 훈련할 수 있는 코드를 직접 작성하는 것도 가능해졌다. 엔비디아는 GPT-4를 사용해 강화학습 알고리즘을 생성하는 AI 훈련 시스템 ‘유레카(Eureka)’를 선보였다. doi: 10.48550/arXiv.2310.12931 강화학습은 어떤 행동을 취할 때 보상을 주고, 최대의 보상을 찾는 방식으로 로봇의 학습을 유도한다. 앞서 소개한 KAIST의 로봇 개 ‘하운드’도 강화학습을 통해 움직임을 배운다. 이때 필요한 강화학습 알고리즘은 인간이 직접 작성해야 한다.

이에 반해 유레카는 로봇의 움직임 학습에 필요한 강화학습 알고리즘을 직접 만든다. 엔비디아 연구팀은 유레카로 로봇이 가위질, 펜 돌리기 등 섬세한 동작을 학습하도록 했다. 그 결과 사람이 직접 작성한 소스코드보다 성능이 80% 이상 뛰어났다고 보고했다.

각개전투 AI 로봇, 앞으로의 연구 전망은 ‘통일’

AI 로봇 개발이 계속된다면 로봇이 인간을 대신할 영역은 더 넓어질 것으로 보인다. 김 책임연구원은 “로봇의 어원이 체코어로 노동을 뜻하는 ‘robota’에서 시작됐듯이, 로봇의 궁극적 목표는 사람을 노동에서 해방해 주는 것”이라고 설명했다. 하지만 모든 노동을 대신할 정도의 AI 로봇이 탄생하기엔 여전히 기술적 한계가 있다. 그 한계를 뛰어넘기 위한 노력에는 무엇이 있을까?

➀ 어떤 로봇에도 적용가능한 학습 모델

AI가 빠르게 발전할 수 있었던 이유 중 하나는 학습 모델이 오픈 소스로 공개돼 있었던 것이다. 좋은 학습 모델들이 모두에게 공개되다 보니, 전 세계의 AI 연구진들은 같은 모델을 가지고 개발에 열중했다. 여기에 풍부한 데이터가 합쳐져 급격한 발전을 이룰 수 있었다. 대표적인 예로 대규모 언어모델은 오픈 소스 모델인 트랜스포머 모델과 풍부한 언어 데이터가 합쳐져 4~5년 사이에 빠른 속도로 발전했고, 챗GPT의 상용화까지 가능하게 했다.

이에 반해 로봇의 학습 모델과 학습 데이터는 연구기관마다, 기업마다 모두 다르다. 또 만들어진 모델은 특정 로봇에만 적용이 가능하다. 김정중 한국기계연구원 인공지능기계연구실 선임연구원은 “앞으로 AI 로봇 시장에선 로봇 학습 모델 통일화가 주된 연구 주제일 것”이라며 “다양한 로봇, 작업, 환경에서 학습된 데이터를 바탕으로 어떤 로봇에도 적용가능한 학습 모델을 개발한다면 로보틱스 분야 발전에도 추진력을 얻을 것”이라고 설명했다.

관련된 연구에는 구글 딥마인드 주도로 전 세계 약 21개의 연구팀, 100명이 넘는 연구원이 참여한 ‘RT-X’ 모델 연구가 있다. doi: 10.48550/arXiv.2310.08864 국제 공동연구팀은 로봇공학에서도 학습 모델 통합이 가능한지를 확인하기 위해 22개의 서로 다른 로봇을 학습시킨 데이터 세트를 모아 RT-X라는 학습 모델을 만들었다. 그리고 이 모델을 하나의 로봇에 적용해 527개의 서로 다른 임무를 잘 수행하는지 확인했다. 그 결과 특정 임무를 수행하도록 별도로 학습시킨 로봇보다 RT-X로 학습한 로봇이 임무를 평균적으로 20% 더 잘 수행했다. 김 선임연구원은 RT-X에 대해 “장기적으로 성공률이 더 향상된다면, 우리 일상에 로봇이 활용되는 데 큰 기여를 할 것”이라고 말했다.

➁ 스스로 해결책을 생성하는 모델

고두열 한국기계연구원 인공지능기계연구실 선임연구원은 “일반인도 AI 로봇을 활용할 수 있을 정도로 상용화가 되기 위해선 휴대폰처럼 다양한 작업을 알아서 할 수 있는 AI 로봇이 필요하다”고 설명했다. 이전까지 특정 임무 처리 과정이 학습된 로봇을 개발했다면, 앞으로는 어떤 임무든 ‘처리 과정을 추론할 수 있는’ 범용 AI 로봇 개발에 더욱 힘써야 한다는 의미다.

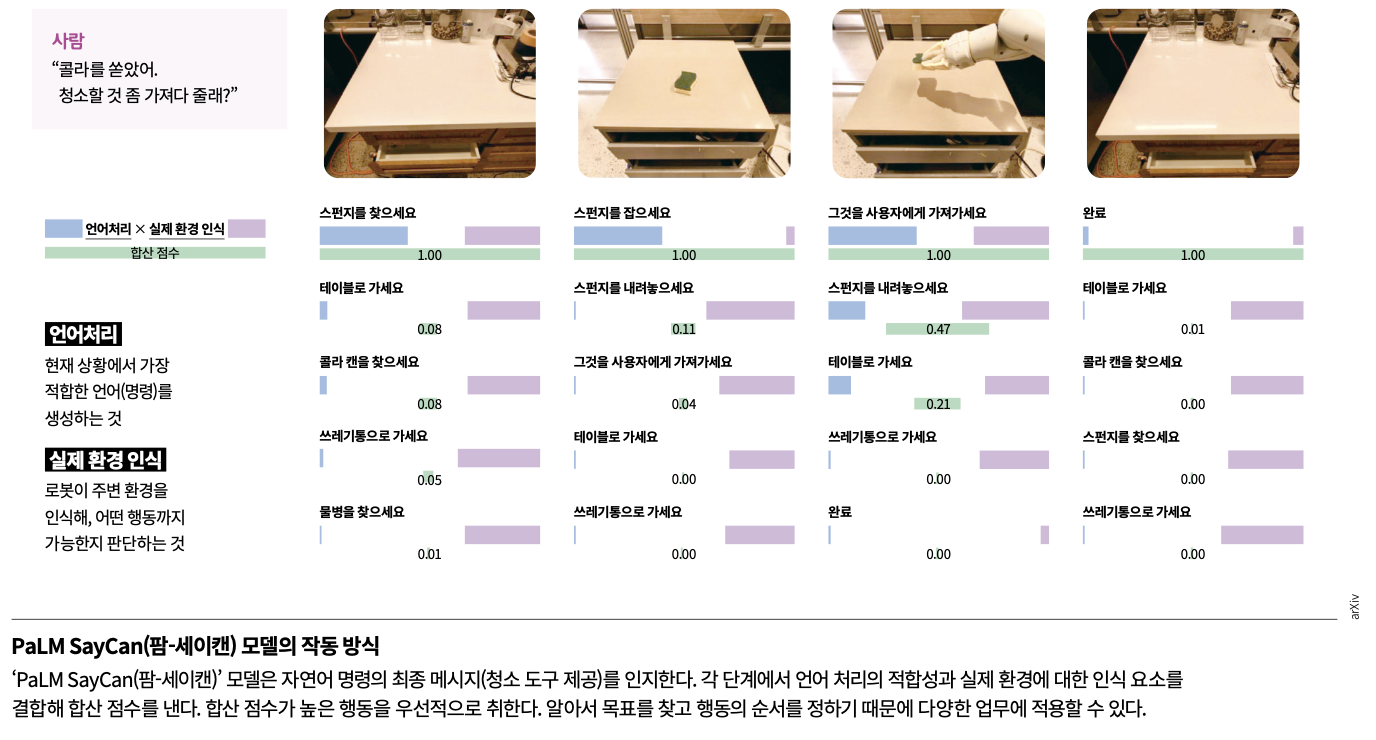

구글이 2022년 발표한 대규모 언어모델 탑재 로봇 ‘PaLM SayCan(팜-세이캔)’ 모델이 좋은 예다. doi: 10.48550/arXiv.2204.01691 팜-세이캔 모델은 자연어로 도움을 청하면 스스로 목표를 찾고, 목표를 수행과 관련된 여러 행동 중 가장 먼저 해야하는 행동을 찾아 수행한다. 예를 들어 “테이블 위에 콜라를 쏟았는데 도와줘”라고 말하면 궁극적 목표가 ‘콜라를 닦는 것’임을 파악하고 그와 관련된 행동들을 찾는다. 이중 ‘콜라 캔 찾기’를 가장 먼저 수행해야함을 파악하고 그 다음에 이어질 적절한 행동을 찾아 하나씩 수행한다. 팜-세이캔 모델처럼 알아서 목표를 찾고 수행 순서를 정한다면 어떤 임무에도 적용이 가능해, 범용 AI 로봇 개발로 이어질 수 있다.

완벽하게 인간을 닮은 로봇 개발까지 가는 길 위에서 AI와 로봇공학의 위치를 보면, 로봇공학이 AI보다 뒤쳐진 것은 사실이다. 이 차이를 극복하기 위해 로봇공학은 통일된 학습 모델 개발과 임무 처리 과정을 추론하는 연구로새로운 돌파구를 찾고 있다. 아직 갈 길은 멀다. 김 책임연구원은 “로봇 작업 모델을 통합하려는 시도는 시작단계”라며 “상용화에 도달한 AI와 비슷한 수준으로 가기 위해선 더 높은 임무 수행률과 외부 실세계와 보다 정확하게 상호작용할 수 있는 로봇 연구가 더욱 필요하다”고 설명했다.