아주 한참을 기다린다

모든 굴레를 벗어나

내가 된 세상

내 마음과 가장 깊은 곳에서

나를 열어주는 수 있는

그 삶 속으로

더 낮은 곳으로 가라앉는다

위 시는 인간의 지능과 ‘인간이 만든 지능’이 함께 썼다. 포스텍 인공지능(AI) 연구원에서 개발한 시 쓰는 AI ‘Seq2Seq’ 모델 이야기다. Seq2Seq 모델은 사용자가 첫 행을 입력하면 그에 어울리는 다음 행을 제시하는 참여형 프로그램이다. 이 시에서 인간은 ‘아주 한참을 기다린다’란 행만 썼다. 뒤를 이어 두 번째 행부터 끝까지 쓴 건 AI다(5행의 ‘열어주는’은 ‘열어줄’의 오타로 보임).

시인, 작곡가, 화가. 모두 AI가 대체할 수 없을 거라고 예상하던 직업이다. 그런데 2022년 우리는 그 반례를 수없이 목격했다. 8월엔 카카오브레인이 개발한 시 쓰는 AI ‘시아’가 첫 번째 시집 ‘시를 쓰는 이유’를 출시했다. 안창욱 광주과학기술원(GIST) AI대학원 교수팀이 개발한 AI작곡가 ‘이봄(EvoM)’이 작곡한 음원이 12월 발매됐다. 7월 출시된 미드저니(Midjourney)가 그린 그림은 미술대회에서 우승을 차지했다.

같은 해 가을엔 OpenAI가 출시할 예정인 자연어처리 AI, GPT-4가 ‘튜링 테스트’를 통과했다는 소문이 돌았다. 튜링 테스트는 기계와 인간을 구분하기 위해 고안된 시험이다. 이런 사례들은 AI는 넘보지 못할, 인간의 정체성에 대한 질문을 던진다. 질문에 답을 하기 위해선 우선 인간의 지능과 AI의 지능이 어떻게 같고 다른지 짚어봐야 한다.

고래 지느러미와 사람 손처럼 같다

서로 모양이 달라 잊어버리기 쉽지만, 고래 지느러미와 사람 손은 같은 뿌리를 갖고 있다. 때문에 골격구조가 비슷하다. 이를 ‘상동기관’이라고 부른다. AI와 인간의 지능도 마찬가지다. 1956년, AI(Artificial Intelligence)란 용어를 처음 말한 사람 중 한 명인 미국의 공학자 존 매카시는 기계에 지능을 부여하고자 인간 두뇌에 있는 신경망을 떠올렸다. 이유는 간단하다. 지능을 구현하기 위해 참고할 만한 예시가 두뇌밖에 없었기 때문이다. AI의 지능은 인간의 지능에 뿌리를 둔 상동기관인 셈이다.

뇌에는 뉴런(신경세포)이 수백억 개 이상 얽혀 있다. 뇌는 뉴런에서 뉴런으로 전기신호를 전달하거나 신경전달물질을 이용해 세포 사이에 화학적 신호를 전달하며 정보를 처리한다. 몸을 움직이는 것, 감정을 느끼는 것, 복잡한 수식을 계산하는 것 등 다양한 활동은 뇌의 각 부위에서 맡아 처리한다.

길을 걷다 만난 친구 ‘말똥이’를 알아보는 과정을 예로 들어보자. 망막에 맺힌 시각 정보는 뇌 뒤쪽 후두엽의 1차 시각피질(Visual cortex)로 전달된다. 여기서 시각정보는 V1, V2, V3 등 시각피질의 다양한 영역을 순서대로 거치며 다시 뇌 앞쪽으로 전달된다. 시각정보가 가장 먼저 지나가는 V1은 이미지의 기본적인 정보인 위치, 밝기 등을 분석한다. V2와 V3에서 물체의 형체를 분석한다. 이어 형태와 색을 분석하는 V4와 운동을 감지하는 V5 등을 거치게 된다. 단순한 형태부터 파악한 뒤 복잡한 모양을 살피는 순으로 시각정보를 인지하는 것이다.

김성신 한양대 데이터사이언스학부 심리뇌과학전공 교수는 “시각피질에서 일어나는 위계적인 정보처리과정은 AI의 핵심기술인 딥러닝에서 사용하는 합성곱 신경망(Convolutional Neural NetworkCNN)과 유사하다”고 설명했다. 시각피질의 정보처리과정을 본떠 개발한 게 합성곱 신경망이기 때문이다.

AI의 다양한 학습 알고리즘 중에서 생명체의 신경망, 즉 뇌에서 영감을 받은 알고리즘을 ‘인공 신경망’이라고 한다. 인공 신경망의 기본 단위는 ‘노드’다. 뇌의 뉴런처럼 데이터를 다음 노드에게 전달한다. 이 노드와 노드 사이의 연결부위를 ‘매개변수’라 부른다. 매개변수는 주어진 데이터를 처리할 때 부여하는 가중치로, 시냅스와 기능이 비슷하다.

앞서 소개한 말똥이를 이번엔 합성곱 신경망을 이용해 알아본다고 하자. 합성곱 신경망은 크게 두 단계로 나뉜다. 사진에서 특징을 추출해 데이터를 추리는 과정인 ‘합성곱 층’과 이렇게 얻은 요약 데이터를 다양한 기준에 따라 분류하는 인공 신경망이다. 앞서 인간의 뇌는 시각 정보를 가장 단순한 실루엣부터 시작해 점차 세부적인 이미지의 특징을 파악하는 식으로 분석한다고 했다. 마찬가지다. 합성곱 신경망에서는 여러 겹의 합성곱 층을 통해 이미지를 단계별로 분석한다.

우리가 사람을 알아보기 위해서 굳이 그 사람의 모공 하나하나까지 들여다볼 필요는 없다. 이목구비가 각각 어떻게 생겼고 어디에 위치하는지만 알면 된다. 마찬가지로 합성곱 층을 지나며 시각 정보는 눈, 코, 입 등 그 이미지의 특징만 추리는 식으로 가공된다. 이렇게 가공된 ‘요약본’을 토대로 인공 신경망이 이 사람이 말똥이일 확률이 몇 퍼센트인지 판별해내는 것이다.

나비의 날개와 새의 날개처럼 다르다

그렇다면 궁금해진다. 합성곱 신경망처럼 뇌의 기능을 모사한 AI를 하나하나 개발하다 보면, 언젠가 뇌를 똑같이, 혹은 더 개선해 만들 수 있을까. 이수영 KAIST 전기 및 전자공학부 교수는 “사람이 날기 위해 새가 나는 모습을 공기역학적으로 분석한 것은 맞다”며 “그러나 그 기능을 모두 구현하진 않았다”고 답했다. 우리는 뇌의 기능 중에서 핵심을 추려 AI에 구현했다. 뇌의 지능과 AI의 지능이 언뜻 비슷해 보여도 그 근간은 다를 수 있다.

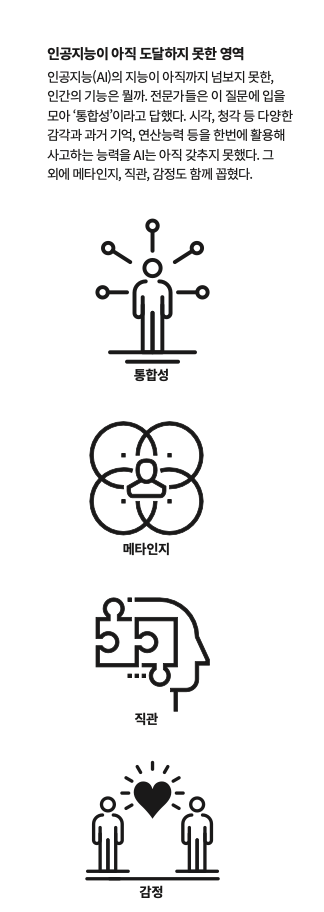

과학동아는 지난 2019년 10월호 ‘인공지능은 인간지능을 넘어섰다’란 기사를 통해 이상완 KAIST 바이오 및 뇌공학과 교수에게 “AI는 인간의 지능을 넘어설 수 있을 것인가”란 질문을 던졌다. 당시 이상완 교수는 “AI가 고도화된 인간의 지능을 따라잡는 것은 다른 차원의 얘기”라고 답했다. AI는 주어진 상황에서 벗어나면 대처 능력이 떨어지기 때문이다. 4년이 지난 지금 같은 질문을 다시 물었다. 이상완 교수는 “같은 답을 할 수 있겠다”며 “일을 해낸다는 측면에서 AI가 사람을 앞선 것은 맞지만, 목적의 본질을 이해하는 사람의 능력에는 도달하지 못했다”고 했다. 이어 “그림을 그리는 AI가 그림을 이해했다고 단언할 수 없고, 바둑을 하는 AI가 바둑을 이해했다고 단언할 수 없다”며 “이해하는 것과 아는 것은 다르다”고 했다.

인간은 바둑을 이해한다. 바둑의 규칙을 이해하고, 상황에 따라 승부를 질질 끌 수도, 일부러 져줄 수도 있다. AI는 그러지 못한다. 바둑을 이기는 방법만 안다. 나비의 날개와 새의 날개가 ‘난다’란 기능은 같지만, 그 구조와 비행방식이 다른 것처럼 AI와 인간의 지능은 다르다.

지능이 만든 인공지능이 만든 인간의 지능

거울에 비춘 듯 닮은 듯 다른 두 지능은 서로 상호보완하며 발전할 전망이다. AI는 인간의 지능을 이해하는 데에 도움이 된다. 김 교수는 현재 AI를 이용해 우리가 시각 정보를 인식한 뒤 근육을 움직이기까지의 정보처리 과정을 이해하는 연구를 한다. 시간에 따라 변화하는 정보를 예측하는 데 활용되는 순환 신경망(Recurrent Neural Network嘝NN)을 이용해 뉴런의 활성화를 예측하는 식이다.

인간의 지능을 이해하면 AI를 보다 인간답게 만들 수 있다. 이수영 교수는 “우리는 ‘잘했어!’와 ‘자알했어~’가 다른 의미임을 구별할 수 있다”며 “사람의 감정이 변화하는 과정과 개인의 성향, 과거 대화 데이터 등을 조합해 목소리의 톤을 듣고 감정을 구분하는 AI를 만드는 게 목표”라고 했다.

한편, 이상완 교수의 연구분야는 인간의 뇌를 통해 AI를, 또 AI를 통해 인간의 뇌를 이해하는 것이다. 실험을 통해 사람의 뇌 데이터와 행동 데이터를 모은다. 그리고 AI를 이용해 이 행동 데이터를 설명할 수 있는 모델을 만든 다음 뇌 데이터와 비교해 그중 실제 뇌의 활성화 패턴과 가장 맞아떨어지는 모델을 고른다.

이상완 교수는 “이렇게 만든 알고리즘은 제한된 상황 속에서 사람과 같은 행동을 하는 가상의 피험자가 된다”며 “이 피험자를 데리고 1000만 번씩 실험을 시켜보면서 이 가상의 피험자를 이해해본다”고 했다. AI를 이용해 사람이 어떤 행동을 ‘무슨 생각으로’ 했는지 파악하는 것이다. 가상의 피험자가 무슨 생각을 했는지 이해한 다음엔 반대로 가상의 피험자가 원하는 대로 움직이도록 유도할 차례다. 사람을 바꿀 수 있는 방법을 알아내기 위해서다.

이상완 교수는 “(앞으로 AI와 인간의 관계에서) 악순환을 경계해야 한다”고 경고했다.

“사람이 사진을 찍을 때 예쁜 것만 찍는다면 이 편향된 데이터를 학습한 AI도 편향되겠죠. 우리의 편견이 AI에 흡수될 수 있습니다. 이렇게 편향이 생긴 AI를 계속 접하다 보면 우리의 편견이 강화될 수도 있죠. 선순환을 유도하려면 사람과 비슷하게 생각하는 AI가 필요합니다. 우리가 어떻게 생각하는지 그대로 바라볼 수 있는 하나의 거울이 될 겁니다.”