설명가능한 인공지능(XAI)과 그래프 이론

인공지능(AI)이 발달함에 따라, 금융의료자율주행 등 실생활과 관련된 다양한 분야에서 AI가 사용되고 있습니다. 그리고 AI가 사용되는 영역은 점점 넓어지고 있죠.

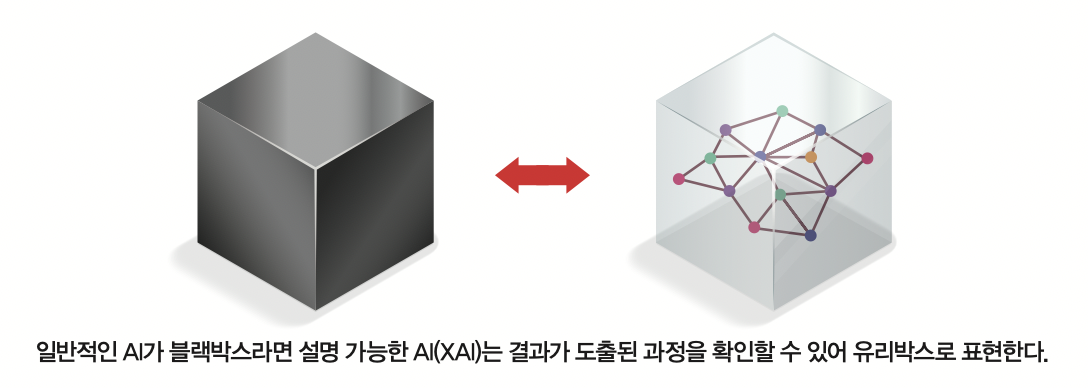

AI는 학습 데이터를 분석해 의사결정에 도움을 줄 수 있는 결과를 도출합니다. 최근에는 빅데이터와 복잡한 알고리듬을 바탕으로 AI가 학습하고 결과를 냅니다. 그런데 AI가 학습 과정에서 잘못된 데이터를 사용하거나 해킹 등 외부에서 방해를 받는 경우에는 적절하지 않은 결과를 출력할 수 있습니다. 심지어 최근에는 전체 과정을 설계한 개발자도 오류의 원인을 즉각적으로 파악하지 못하거나 결과가 어떻게 도출됐는지를 명확하게 설명하지 못하는 상황이 발생합니다. 이런 AI의 속성은 안쪽이 보이지 않는 검은 상자인 ‘블랙박스’에 비유됩니다. 이는 단순히 시간적, 금전적 손실뿐 아니라 인명피해로도 이어질 수 있는 문제입니다.

최근에는 AI가 어떤 과정을 거쳐서 결과를 냈는지를 알 수 있는, 이른바 설명 가능한 AI(XAI, eXplainable AI)가 중요해지고 있습니다. 이름처럼 결과가 나온 ‘이유’를 설명해주는 AI죠. 설명 가능한 AI는 기존 AI의 ‘블랙박스’ 같은 속성과 대비해 ‘유리박스’로 표현할 수 있습니다.

XAI는 AI가 학습하고 결과를 도출하는 과정을 사용자가 시각적으로 쉽게 검토할 수 있도록 만드는 것을 목표로 합니다. 전 세계 유명 대학 및 연구 기관 등도 XAI를 개발하고 있으며, 국내에서는 울산과학기술원(UNIST)을 중심으로 연구가 진행되고 있습니다.

특히 800억 원에 달하는 예산을 XAI에 투자한 미국 국방부 산하 기관인 방위고등연구계획국(DARPA)에서는 수학의 그래프 이론에 기반한 XAI 연구를 적극적으로 지원하고 있습니다. 먼저 그래프 이론을 활용해 인공 신경을 노드로 표현하고 이들의 관계를 링크로 나타낸 다음, 이것을 3차원 상에 시각화합니다. 그러면 실시간으로 확인하고 싶은 부분을 확대, 축소하면서 인공 신경망이 어떻게 작동하는지 파악할 수도 있죠. 이런 XAI를 통해 사람과 AI가 상호작용하게 된다면, 실생활에서 AI를 훨씬 더 잘 활용할 수 있게 될 것으로 기대됩니다.

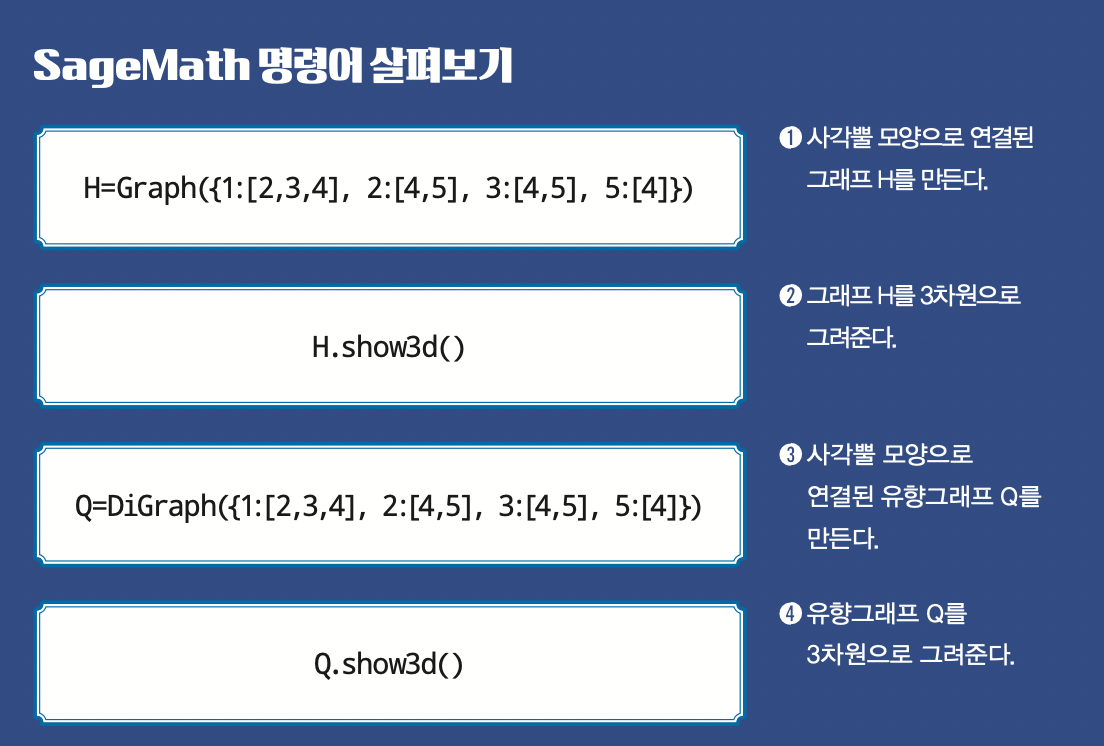

문제 밑면이 사각형인 사각뿔을 꼭짓점 사이의 연결 관계를 나타내는 그래프 이론을 이용해 3차원 그래프로 나타내보자.

★ 폴리매스 홈페이지→[주니어 폴리매스]→[인공지능, 수학으로 타파]에서 자세한 내용을 확인하세요.