나 과학마녀 일리는 이번에 인공지능 경찰관을 개발했어!

그런데 출동하자마자 이 녀석…. 사고를 쳐서 걱정이야! 무슨 일이냐고?

로봇에게도 지켜야 할 원칙이 있다?

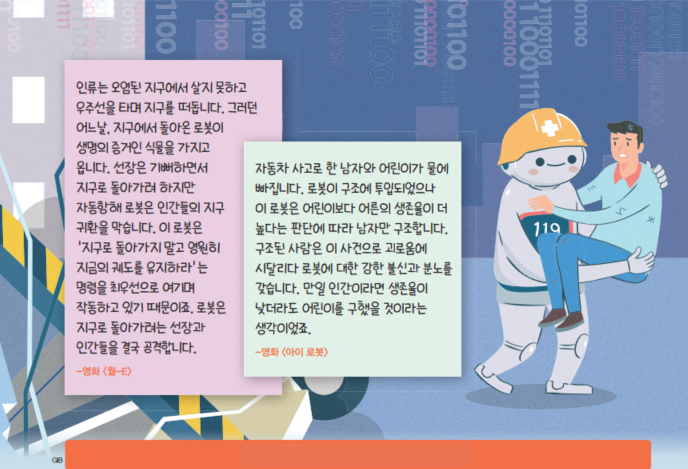

두 영화에는 인공지능의 논리와 인간 윤리가 충돌하는 이야기가 나옵니다. 인공지능이 스스로 사고하게 되면, 인간과는 전혀 다른 기준으로 인간을 공격할지도 모른다는 생각을 기반으로 하는 얘기죠. 여기에는 인공지능이 비윤리적이고 불완전한 인간의 감정이나 도덕을 초월하여 엄격한 기준을 잣대로 인간을 지배할 것이라는 두려움이 담겨 있습니다. 오래전부터 이 주제는 많은 SF 영화와 소설에서 다뤄왔습니다. 미국 SF 소설가 아이작 아시모프는 1942년 소설 <;런어라운드>;에서 로봇 3원칙을 발표하기도 했죠.

소설을 통해 발표된 로봇 3원칙은 인공지능과 로봇 기술의 발달로 그 필요성이 점점 커지게 됩니다. 실제로 우리 사회에서 로봇과 인공지능의 판단의 영역이 점점 더 확장되고 있어요. 로봇이 돌발 상황에서 인간에게 피해를 입힐 수 있는 SF같은 상황이 현실에서 벌어지기도 합니다. 예를 들어 지난 7월, 국제 체스포럼 모스크바 오픈 경기장에선 체스 로봇이 경기를 하다 오작동을 일으켜 상대 소년의 손가락을 부상시키는 사건이 발생했습니다. 미국 캘리포니아의 한 쇼핑센터에서 보안 업무를 담당하던 무게 136kg, 신장 152cm의 로봇이 16개월 된 유아를 공격하는 일도 있었습니다. 하지만 이 사건들은 갑작스러운 돌발 상황에 로봇이 반응하여 일어난 사고에 가깝습니다.

다행히 의도적으로 로봇이 판단하여 인간을 공격하는 상황은 아니었죠.

로봇 3원칙

➊ 로봇은 인간에게 해를 가하거나, 혹은 행동을 하지 않음으로써 인간에게 해를 끼치지 않는다.

➋ 로봇은 첫 번째 원칙에 위배되지 않는 한 인간이 내리는 명령에 복종해야 한다.

➌ 로봇은 첫 번째와 두 번째 원칙을 위배하지 않는 선에서 로봇 자신의 존재를 보호해야 한다.

인공지능에게도 윤리는 필요해!

지난해 우리나라에서는 ‘AI 챗봇 이루다’가 출시되자마자 논란을 일으키고 서비스가 중단되는 문제가 발생했습니다. 인공지능에게 말을 걸자 인종차별, 성차별 등 각종 혐오로 가득한 대화가 진행되었기 때문이었죠. 아마존이 야심차게 개발한 인공지능 채용 서비스도 문제가 되었습니다. 응시자의 언어를 판단하여 여성 지원자를 탈락시키는 성차별적 판단을 했거든요. 이뿐 아니라 영국의 인공지능 비자 신청 프로그램은 백인이 아니거나 특정 국가에서 온 사람들을 더 오랫동안 심사하거나 탈락시키는 등 차별적인 판단을 해 폐기 처분되었어요. 미국 미시간주에선 지난해 한 흑인이 얼굴 인식 시스템 착오로 경찰에 억울하게 체포됐고요. 인공지능이 일으키는 윤리적인 문제는 이처럼 이미 곳곳에서 포착되고 있습니다.

인공지능의 이러한 차별적 행태에 대해 연구자들은 인공지능의 문제는 인간의 문제라고 지적합니다. 인공지능이 차별적인 건 인간 사회가 불평등하고, 권위적이며, 차별적이기 때문이죠. 인공지능은 인간 세상에서 만들어진 데이터를 학습하고 이 데이터에 기반하여 판단을 합니다. 예를 들어 챗봇이 학습한 데이터는 보통 미디어 이용자들의 대화입니다. 채용 프로그램은 이제까지 이루어진 채용 과정을 담은 데이터입니다. 인공지능 비자나 인식 시스템들은 그간 인간이 해 온 판단에 차별이 만연했음을 드러냅니다.

인류가 불평등하고 비윤리적인 데이터를 계속해서 생산한다면, 그것을 학습하는 인공지능은 인간이 가진 비윤리성에 기반해 업무를 수행할 것이며, 이것은 결국 인류의 지속가능한 미래를 위협할 거예요. 결국 인간의 윤리에 대한 책임감을 생각해 봐야 해요. 우리가 디지털 시민으로서 올바르게 행동하고, 판단하는 것은 미래에 보다 큰 도움이 될 수 있습니다. 동시에 기업들이 인공지능에 어떤 데이터를 사용하는지 인공지능 서비스에 문제가 없는지 시민사회의 일원으로 관심을 가지고 비판적으로 바라보는 것도 매우 중요합니다.

인류는 이미 스스로가 만든 과학기술로 인류 자신에게 많은 피해를 입힌 역사를 가지고 있습니다. 그 피해는 기계가 아니라 인간 자신의 잘못된 판단 때문이었죠. 최근의 인공지능과 로봇의 윤리에 대한 논란은 우리들의 미래 또한 기계가 아닌 인간에 달려있음을 보여주는 것이 아닐까요?

●필자소개

박유신(서울 석관초 교사)

서울 석관초등학교 교사입니다. 애니메이션과 미디어, 그리고 미디어 리터러시에 대해 연구하고 글을 쓰고 있습니다. 전국 미디어리터러시교사협회 회장입니다.

다음Mission

아시모프의 로봇 3원칙을 오늘날의 인공지능 상황에 맞추어 고쳐봅시다. 여러분이 만든 인공지능 3원칙을 친구들과 함께 살펴봅시다.

참여 방법

어과수 홈페이지-포스팅에 [디지털 바른 생활] 말머리를 달아 올리기.