딥러닝마트 3층은 일상을 스마트하게 바꿔주는 딥러닝 상품을 전시 및 판매하고 있습니다. 오늘 고객 여러분께 소개할 ‘신상’은 검색과 번역, 고객상담 분야를 평정하고, 인공지능 스피커 탑재를 준비 중인 딥러닝 ‘버트’입니다!

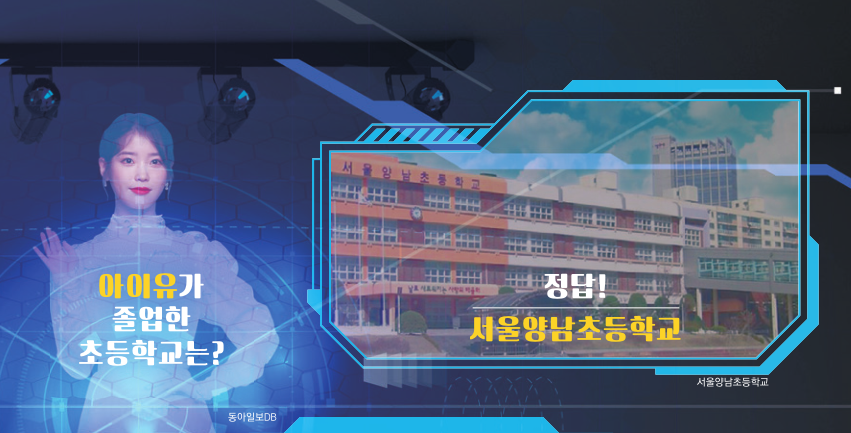

‘가수 아이유가 졸업한 초등학교는?’

무슨 생뚱맞은 질문이냐고요? 아이유의 팬이 아니라면 쉽게 알아내기 어려운 질문의 답을 딥러닝이 척척 해줄 수 있거든요. 실제로 카카오브레인에서 개발한 딥러닝 한국어 모형은 2019년 1월 인공지능 한국어 학습 데이터를 이용한 기계 독해 능력 평가에서 사람보다 높은 점수를 받았습니다. 이 시험은 한국어 학습 데이터에서 추출한 내용을 질문했을 때 답을 얼마나 잘 맞히는지 알아보는 시험입니다. 예를 들면 가수 아이유에 대한 정보를 나열하고 아이유가 졸업한 초등학교를 묻는 식이죠.

이 딥러닝 한국어 모형은 구글이 2018년에 개발한 버트라는 딥러닝 언어 모형의 한국어 버전입니다. 버트는 구글 검색과 번역 서비스는 물론, 채팅으로 고객상담을 하는 여러 기업의 챗봇 서비스에 이미 적용된 기술입니다. 우리가 모르는 사이 매일 이용하고 있는 생활 속 딥러닝 기술이라고 할 수 있죠. 버트가 특별한 이유는 어느 분야의 용어든지 잘 인식할 수 있는 확장성 때문입니다. 이전까지는 그 영역에 특화된 데이터로 훈련시켰습니다. 하지만 버트는 인터넷 백과사전인 ‘위키피디아’의 대중적인 자료를 가지고 만든 모형이어서 학습량이 방대합니다. 덕분에 많은 자료로 학습시킨 버트 모형은 일정 부분만 변형해서 필요한 언어나 분야에 적합하게 사용할 수 있습니다.

뭐든 척척 알아듣고 답하는 버트의 비밀은 전이학습

버트가 분야를 가리지 않고 뛰어난 언어 인식 능력을 발휘하는 비결은 ‘전이학습’이라는 방식을 적용했기 때문입니다. 전이학습이란 특정 분야를 학습하면서 배운 지식을 다른 분야를 학습할 때 활용하는 것을 말합니다. 예를 들어 바이올린 연주법을 배운 사람은 첼로 같은 현악기를 배울 때 자연스럽게 바이올린에 대한 지식을 적용하게 됩니다. 버트는 일반적인 언어에 대해 학습한 지식으로 언어 모형을 만들고, 전이학습 방식으로 그 모형을 전문적인 분야에 적용해 높은 성능을 나타냅니다.

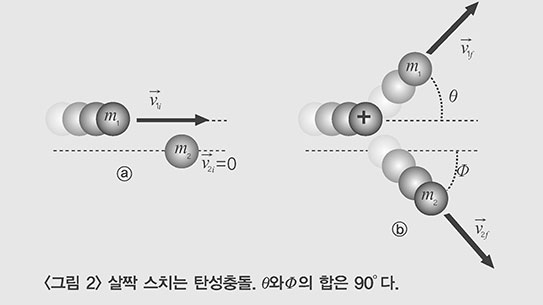

전이학습 1단계 언어 모형 만들기

위키피디아 등에서 추출한 3300억 개의 단어를 이용해 단어와 문장 구조를 학습한다. A와 B 두 문장을 입력한 뒤, 단어의 15%를 지워서 빈칸에 들어갈 단어와 A와 B 문장의 선후 관계를 알아맞히도록 훈련한다.

전이학습 2단계 모형 최적화하기

전이학습에는 다양한 종류가 있다. 합성함수의 일부분을 재사용하거나 마지막 부분만 다른 함수로 교체하는 방식, 학습으로 완성된 가중치를 새로운 합성함수에 적용한 뒤 해당 분야의 데이터를 이용해 학습시키면서 가중치를 적절하게 조정하는 방식 등이다. 버트는 완성된 언어 모형에 추가적인 인공신경망을 더해 원하는 질문에 대한 답을 찾을 수 있게 만들었다.